Google Research Titans Reinventa los Trasformers en Inteligencia Artificial

En el mundo de la inteligencia artificial, los modelos de lenguaje como los basados en Transformers han revolucionado la forma en que se procesan secuencias largas de datos. Sin embargo, estos modelos enfrentan un problema importante: a medida que aumenta la cantidad de datos que procesan, los requisitos de memoria y tiempo de cálculo crecen de manera descontrolada, dificultando su uso en tareas como el modelado de lenguaje, análisis de videos y predicciones de series temporales. Para resolver este desafío, Google AI Research ha presentado Titans, una nueva arquitectura que promete ser un cambio revolucionario en el campo.

Uno de los aspectos más interesantes de Titans es cómo intenta replicar algo que los humanos hacemos de manera natural: sorprendernos cuando encontramos algo nuevo o inesperado.

En términos técnicos, el sistema de memoria de Titans tiene la capacidad de identificar patrones "sorprendentes" o inusuales en los datos. Estos patrones son marcados y almacenados en su memoria a largo plazo, lo que le permite aprender de forma adaptativa incluso durante el tiempo de prueba (test time). Es como si el modelo estuviera "prestando atención" especial a aquello que no encaja con lo que ya conoce.

Por ejemplo: Imagina que estás viendo una serie de números que siguen un patrón claro, como 1, 2, 3, 4, 5. Si de repente aparece un 99, eso llamaría tu atención de inmediato. Para Titans, este 99 sería un dato sorprendente, y lo almacenaría en su memoria para entender por qué ocurrió y cómo podría relacionarse con futuros datos.

¿Por qué es importante esta capacidad?

Adaptación en tiempo real: A diferencia de los modelos tradicionales, que necesitan ser reentrenados para incorporar nueva información, Titans puede ajustarse sobre la marcha.

Mejor comprensión de contextos complejos: Este enfoque le permite manejar datos que no siguen patrones estrictos, como el lenguaje humano o fluctuaciones en ventas.

Eficiencia en memoria: En lugar de guardar todo, como hacen otros modelos, Titans se enfoca en lo relevante o sorprendente, ahorrando recursos.

Esta "sorpresa" es una forma de emular cómo los humanos aprendemos de nuestras experiencias, lo que hace que Titans no solo sea más eficiente, sino también más inteligente y humano en su comportamiento. Es un gran paso hacia sistemas de inteligencia artificial que entienden y reaccionan de manera más natural al mundo que los rodea.

¿Qué hace diferente a Titans?

La principal innovación de Titans es su enfoque en la memoria. Este modelo combina dos tipos de memoria:

- Memoria a corto plazo: Usa un mecanismo de atención tradicional para manejar dependencias inmediatas.

- Memoria a largo plazo: Integra un módulo de memoria neuronal que almacena información histórica y permite procesar contextos extremadamente largos, incluso de más de 2 millones de tokens.

Gracias a esta combinación, Titans logra mantener un equilibrio entre eficiencia y capacidad de aprendizaje.

Tres variantes para diferentes necesidades

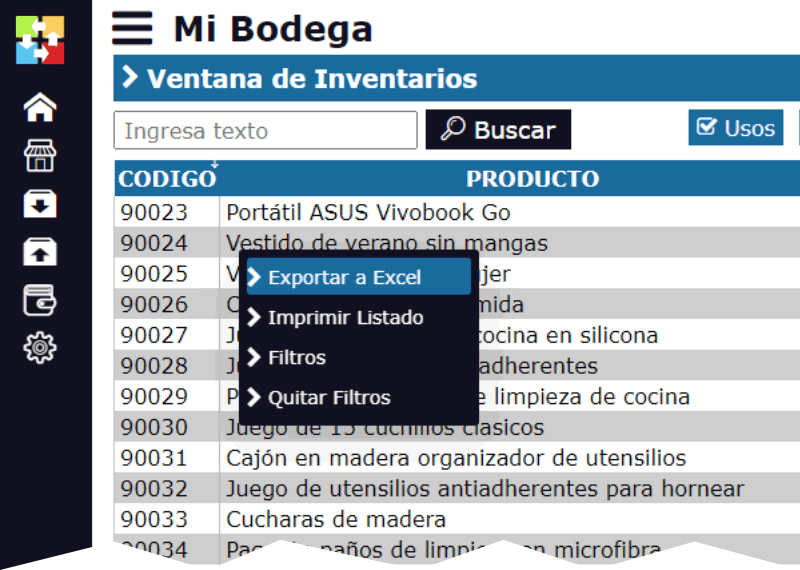

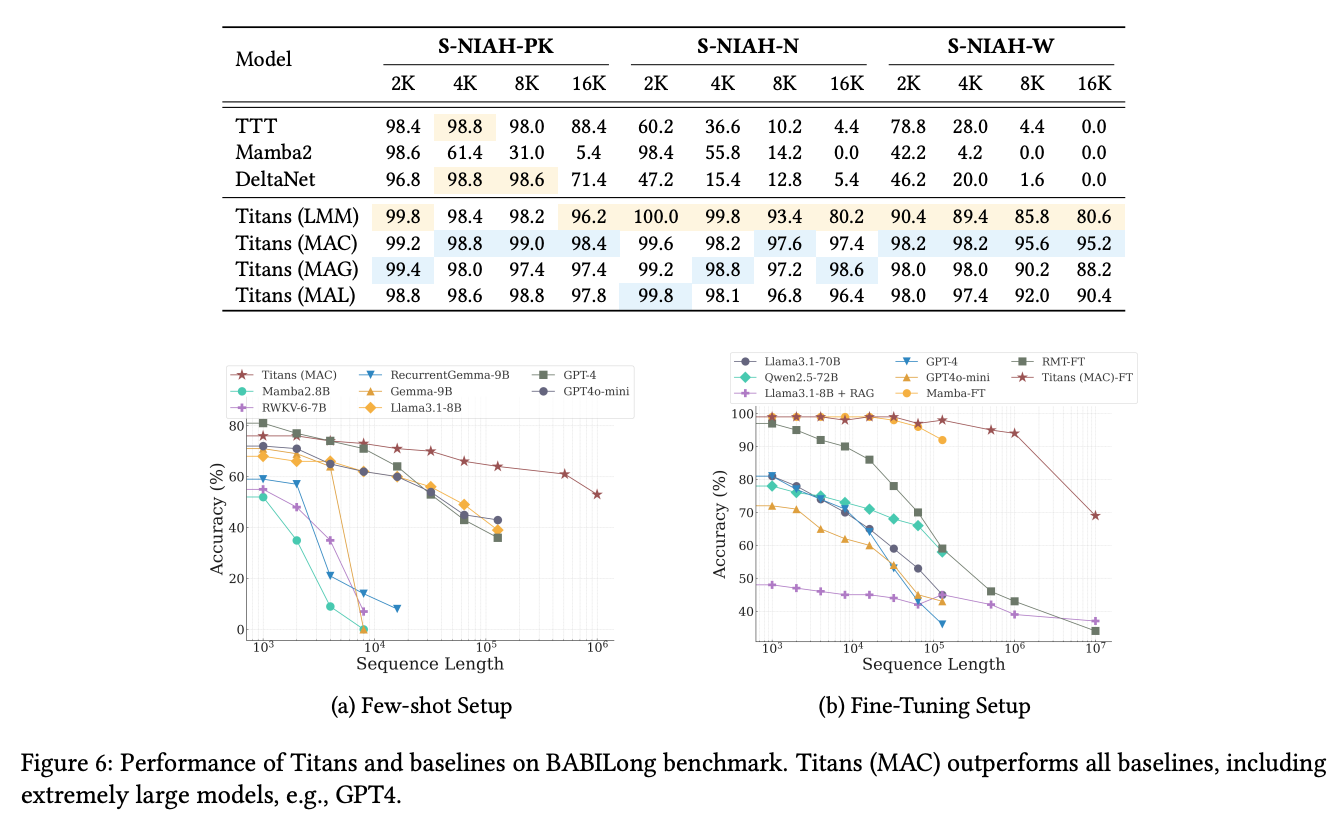

Titans incluye tres variantes principales, cada una diseñada para integrar la memoria de manera diferente:

- MAC: Excelente para manejar dependencias largas y detectar patrones complejos en grandes volúmenes de datos.

- MAG: Similar a MAC, pero con un enfoque más optimizado para tareas específicas.

- MAL: Aunque es menos potente que las anteriores, supera a muchos modelos híbridos existentes.

Estas variantes se destacan por su rendimiento en tareas complejas como la búsqueda de "una aguja en un pajar", procesando eficientemente secuencias de entre 2,000 y 16,000 tokens.

Innovaciones técnicas

El diseño de Titans incluye mejoras técnicas que lo hacen destacar:

- Conexiones residuales: Facilitan el flujo de información en el modelo.

- Activación SiLU: Mejora la precisión en el procesamiento de datos.

- Capas convolucionales separables en 1D: Aumentan la eficiencia sin sacrificar calidad.

- Normalización avanzada: Permite un manejo más eficiente de consultas y claves en la memoria.

Estas características permiten a Titans no solo procesar grandes cantidades de datos, sino hacerlo con mayor precisión y menor consumo de recursos.

¿Por qué importa Titans?

Titans representa un gran paso adelante en la inteligencia artificial. Su capacidad para manejar contextos extensos abre nuevas posibilidades en áreas como:

- Análisis de datos históricos: Por ejemplo, en ventas o inventarios.

- Predicción de tendencias: En sectores como finanzas o marketing.

- Procesamiento de lenguaje natural: Para chatbots más inteligentes y traducciones automáticas más precisas.

Además, la arquitectura de Titans demuestra que es posible superar las limitaciones tradicionales de los modelos basados en Transformers, allanando el camino para nuevas aplicaciones.

Conclusión

Google AI Research ha presentado una solución innovadora a uno de los mayores desafíos en el modelado de secuencias: el manejo de contextos largos. Con Titans, se introduce una arquitectura capaz de memorizar, aprender y adaptarse en tiempo real, algo que promete transformar cómo se desarrollan y utilizan los modelos de aprendizaje automático en el futuro.

Si bien Titans es un avance técnico impresionante, también nos recuerda que la tecnología sigue evolucionando para enfrentar los desafíos más complejos. ¿Qué otras maravillas nos traerá el futuro de la inteligencia artificial? Solo el tiempo lo dirá.